ビデオやボイスチャットなどを利用したサービス「Discord」を運営するDiscord Incは、2020年7月1日から12月31日の透明性レポートを公開した。

(画像はDiscord公式サイトより)

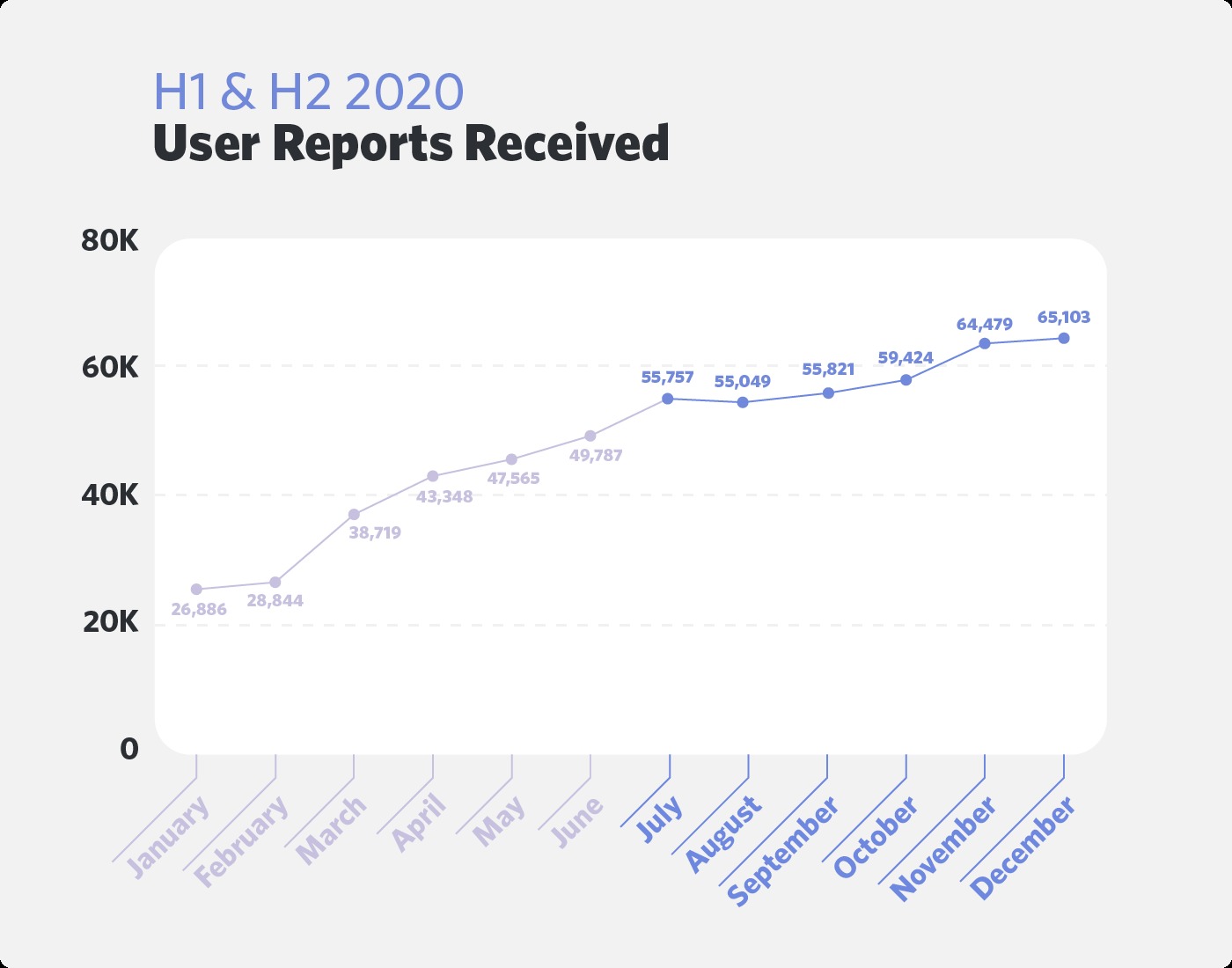

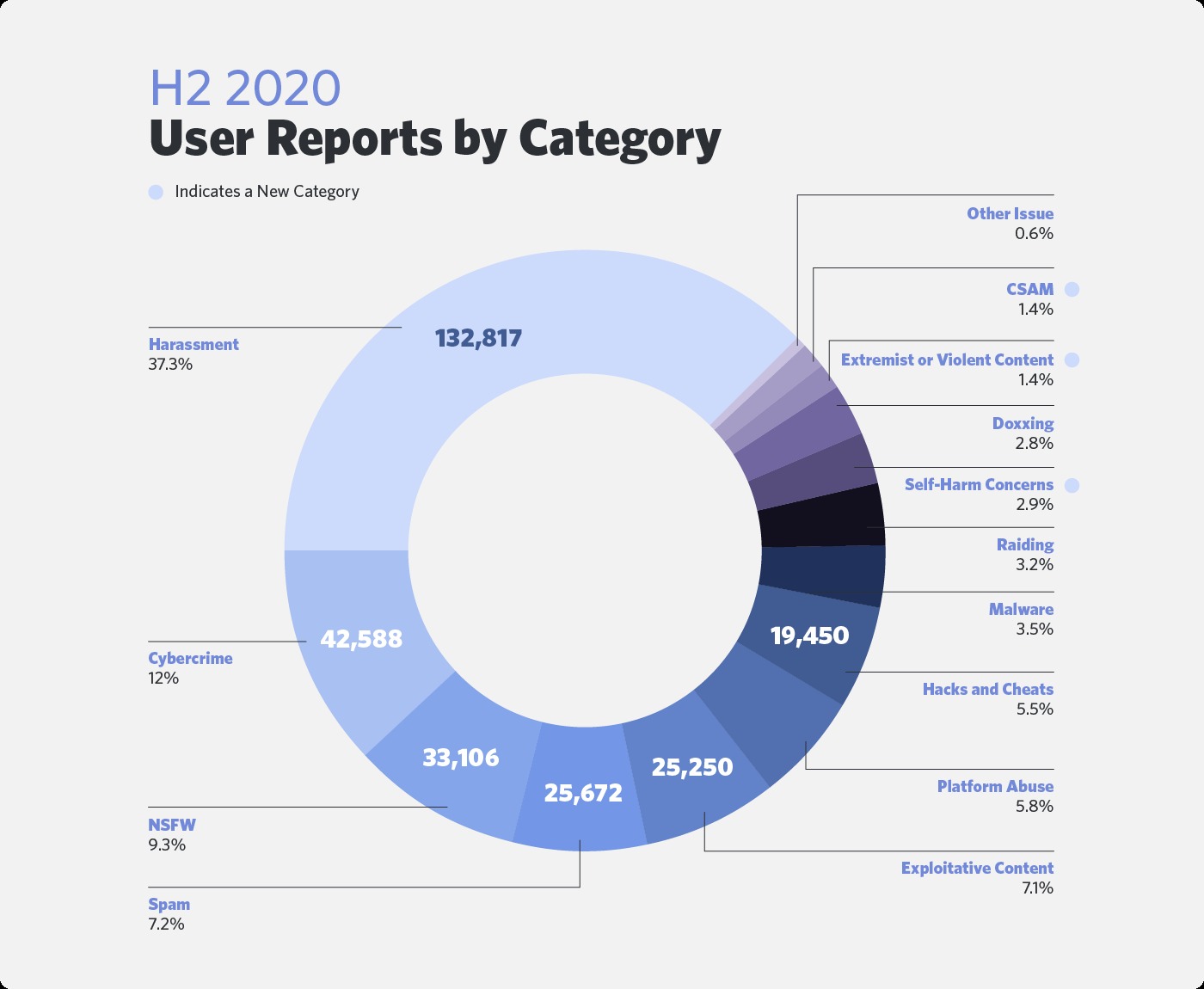

2020年6月に月間アクティブユーザー数が1億人を突破したDiscordだが、12月には1億4000万人を突破。それに伴い、コミュニティガイドラインに違反した有害なユーザーを通報するユーザーレポートも増加。2020年1月には2万7000件だったレポートは、同年12月には6万5000件と2.4倍に増加した。ガイドライン違反はハラスメントやサイバー犯罪、スパムなどさまざまだが、どれかひとつのカテゴリの増加ではなく全体的に増加しているという。

ユーザーの増加は、新型コロナウイルスの感染拡大が大きく関係しているとされている。現実で会えない人々が、気軽にコミュニケーションを取るための方法として広く受け入れられたようだ。Discordはすでにビデオゲーム向けのコミュニティソフトではなく、幅広い人々をつなげるサービスとなった。

(画像はDiscord公式サイトより)

カテゴリ別ユーザーレポートの内訳では、もっとも多いのは一般的な嫌がらせ行為(ハラスメント)だ。それに続いてサイバー犯罪、NSFW(ポルノコンテンツなどの総称)、スパムが続いている。

今回から、CSAM(児童性的虐待コンテンツ)、過激派または暴力的なコンテンツ、および自傷行為の懸念という新しいカテゴリが新設された。上記の円グラフを見ても分かるとおりこれらはまだ割合としては小さいが、「もっとも優先度の高い」カテゴリのため個別に追跡することとなったという。なお、CSAMはNSFWは異なる。CSAMは子供に害を及ぼすコンテンツや行動を示している。

(画像はDiscord公式サイトより)

(画像はDiscord公式サイトより)

これらの通報を受けた後、Discord Incが何らかの対策を講じた割合をカテゴリ別にまとめたのが上図だ。対策とは、アカウントやサーバーの削除、一時的なアカウントの禁止、コンテンツの削除など、複数ある。対策率が3割を超えるのは、CSAM、サイバー犯罪、Doxxing(さらし行為)、Exploitative Contents(搾取的コンテンツ)、過激派または暴力的なコンテンツ、マルウェア、NSFWだ。

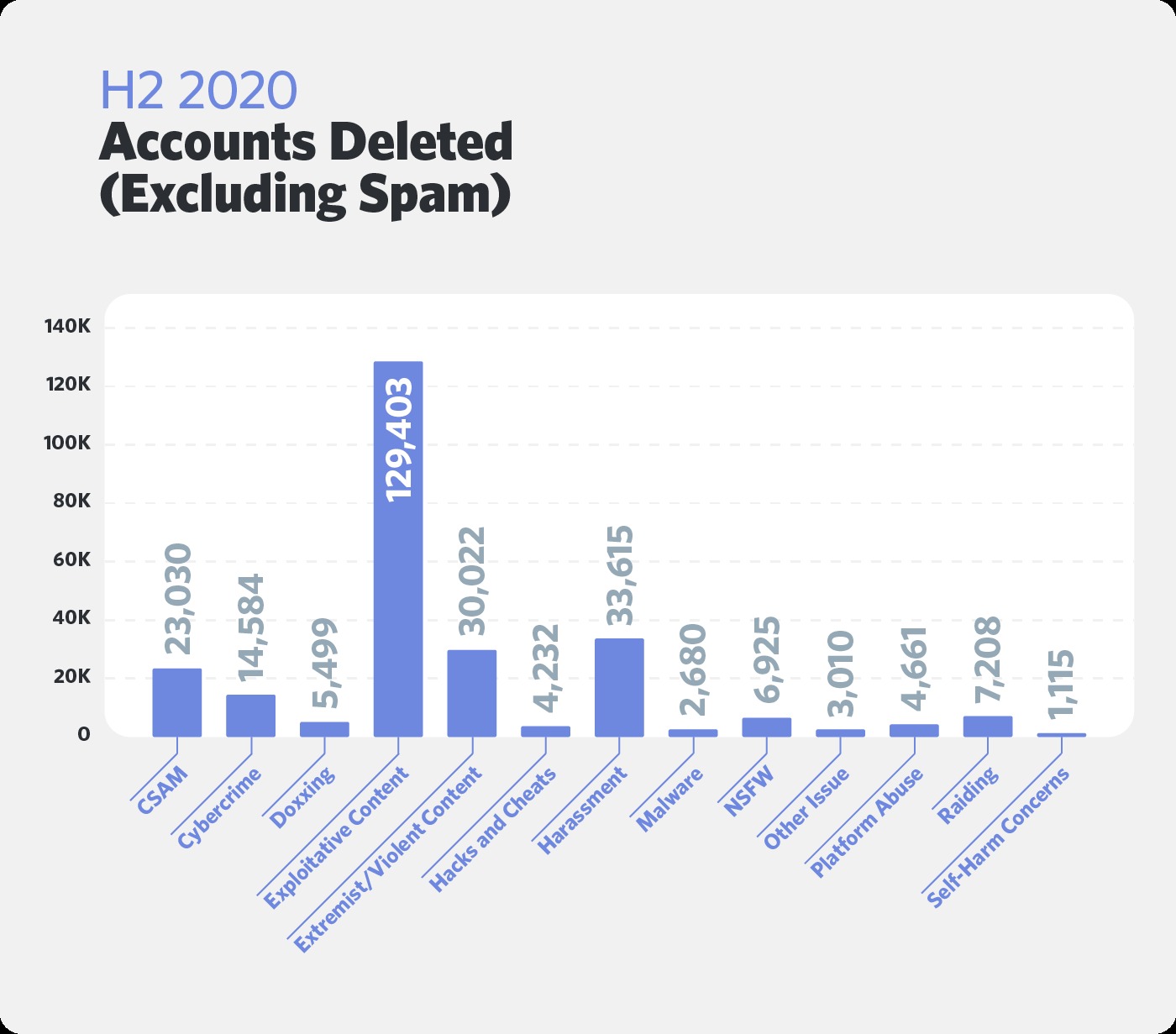

もちろん通報がなくとも自発的にアカウントの削除などの対策を取ることも多い。特に多いのはスパムアカウントだ。2020年後半に削除されたスパムアカウントは320万アカウント以上。スパム以外のアカウントで削除されたのは26万アカウントを超える。

また、CSAMと過激派または暴力的なコンテンツは積極的に取り締まっており、通報数がもっとも多いハラスメント行為に次ぐ削除数となっている。CSAMコンテンツを投稿した場合、NCMEC(全米行方不明/被搾取児童センター)に通報されることもある。

(画像はDiscord公式サイトより)

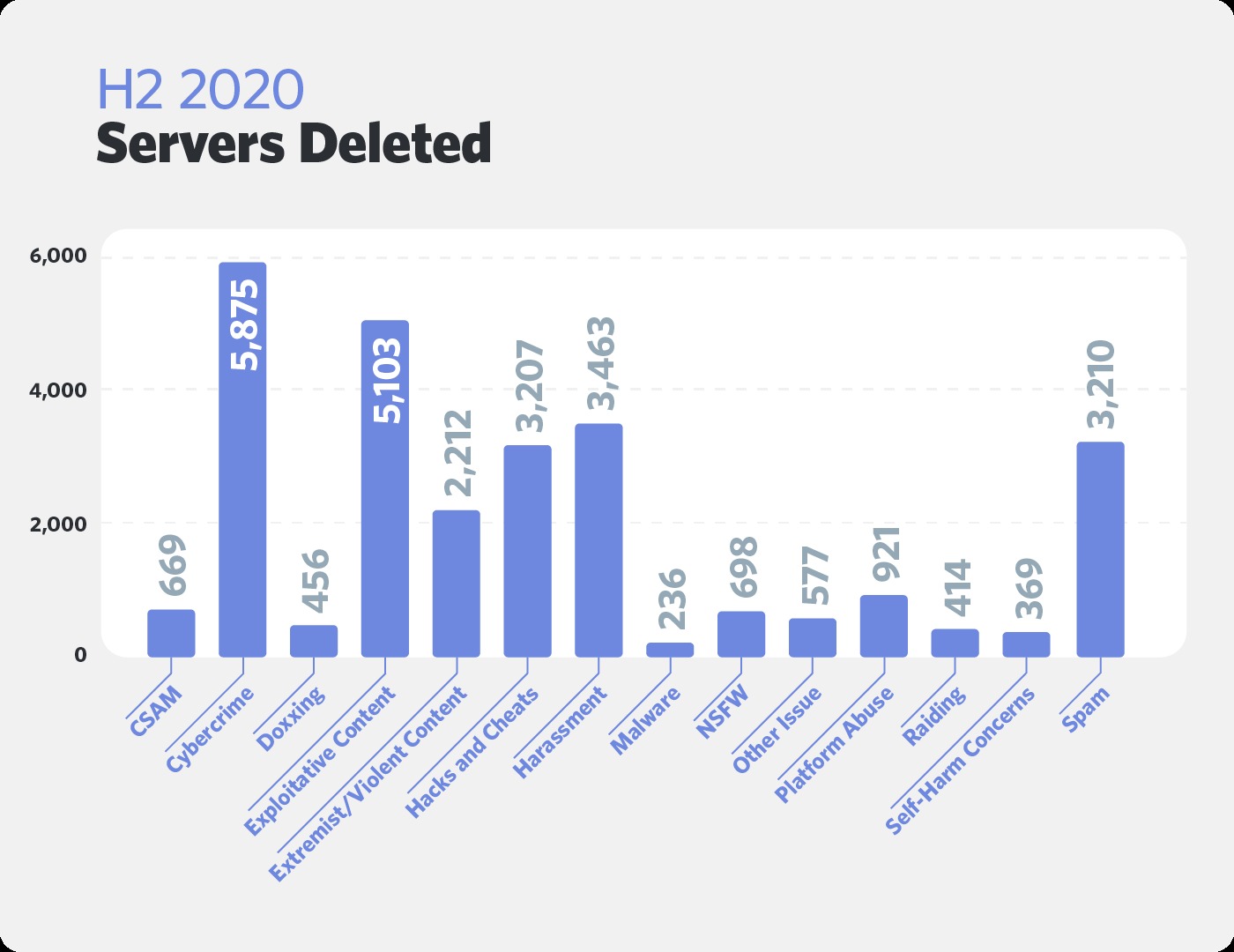

上図は2020年下半期に停止されたサーバー数とそのサーバーが扱っていたコンテンツだ。2万7410台ものサーバーが停止されており、もっとも多かったのはサイバー犯罪を取り扱うサーバーだ。同期間中に5800台以上のサイバー犯罪系サーバーが停止された。割合でいえば約20%ほどとなっている。サイバー犯罪のサーバー削除数は2020年前半から140%も急増したという。

サイバー犯罪を通報するユーザーレポート数も急増しており、その結果Discord Incにタグ付けされたサーバーが最終的に停止された。過激派または暴力的コンテンツを取り扱うサーバーには、ブーガルー運動(アメリカの過激派極右反政府運動)を行うブーガルーボーイズ、陰謀論者のグループQAnonなどが含まれる。Discord Incはこういったサーバーに対しても積極的に対応していくとしている。

DiscordもTwitterやFacebookと同じで匿名で何でも話せる場所ではなく、一定の行動に対してはさまざまな罰則が定められた空間だ。また、法執行機関からの要請には対応する義務もあり、Discord Incの法務部門の審査を経て必要であることを認めた場合、ユーザーデータが受け渡される。これは米国内だけでなく世界中で行われている。米国外のユーザーなら大丈夫というわけではない。

一般的な意味でDiscordの言論の自由は保障されているはずだが、それはあくまでガイドラインに沿った行動を取っている場合に限られることは覚えておきたい。

ライター/古嶋誉幸