X社は1月6日、同社が運営するソーシャル・ネットワーキング・サービス「X」において、違法コンテンツが含まれる投稿に対する声明を発表した。

本声明では、違法コンテンツを含む投稿に対して、投稿の削除やアカウントの永久凍結などを含む対応を行うことにくわえ、行政や法執行機関と協力するなどの措置をとると明言。違法コンテンツの一例として、児童性的虐待素材(CSAM)が挙げられている。

Xでは、違法コンテンツ(児童性的虐待素材(CSAM)を含む)が含まれる投稿に対して、投稿の削除、アカウントの永久凍結などを含む対応を行うことに加え、行政や法執行機関と協力するなどの措置をとります。… https://t.co/EZRQ4TE1Dw

— X Corp. Japan (@XcorpJP) January 6, 2026

また、xAI社が開発したGrokを使用して違法コンテンツを作成した場合や、Grokに違法コンテンツの作成を促すなどの行為を行った場合も、違法コンテンツをアップロードした場合と同様の措置が取られるという。

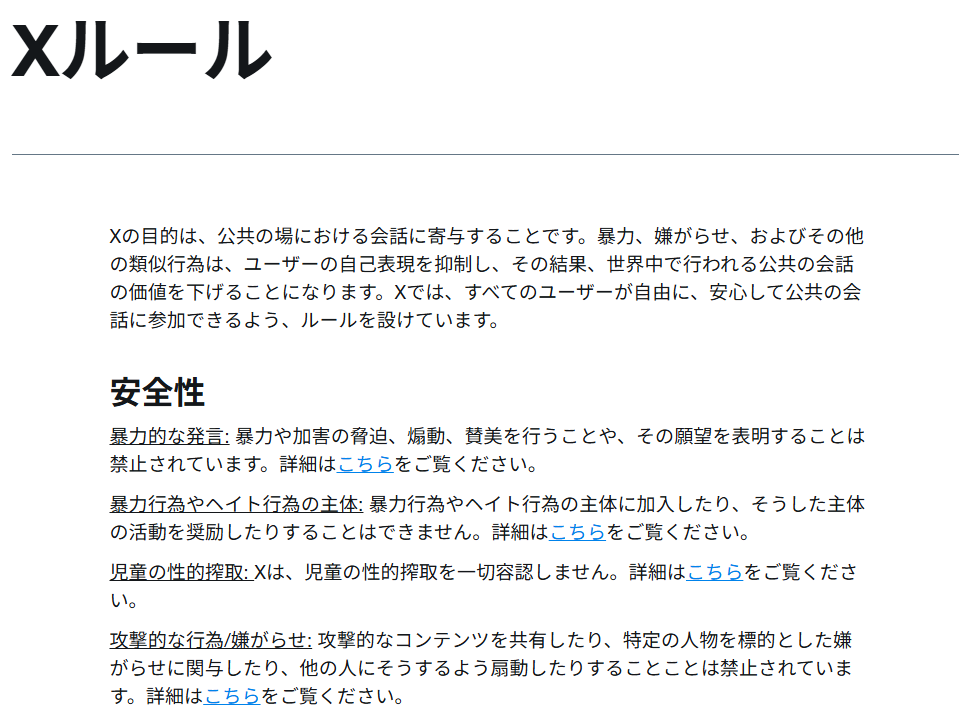

違法コンテンツの詳細については、X社が公開している「強制的対応の適用レベルと適用範囲」および「Xルール」内にて明記されている。該当ポストに記載されている児童性的虐待にくわえ、違法な活動を促進させるためのXの利用の禁止や、個人情報の公開および合意のない裸体の描写といったプライバシーの侵害、著作権や商標の侵害などのケースが該当する。詳細は各ページにてご確認いただきたい。

またXでは、2025年12月24日時点で、投稿された画像をAI編集するボタンが追加されている。ワンボタンで誰でもAI画像編集が可能となったことで、他者の投稿もAI編集が容易になり、Xユーザーの間で懸念が広がっている状況だ。現在までに、本機能を使って画像を無断でAI加工する行為も相次いでいる。

なお、2026年1月15日には「利用規約とプライバシーポリシーの改定」が施行される予定となっている。本規約改正では、Xの使用時に取得したプロンプトや出力、情報など、ポストおよび作成するコンテンツに対して、ユーザーが責任を負うことをより明確にする記述が存在している。