nVidiaは、GeForce RTX GPUのAI機能をライブストリームに応用する「RTX Broadcast Engine」を発表した。

グリーンバック不要のクロマキー合成「RTX Greenscreen」、Webカムを使ったフェイストラッキング「RTX AR」、スタイルトランスファー技術を用いた合成機能「RTX Style Filters」が提供される。これらはすべてRTXシリーズに搭載された深層学習向けのTensorコアで行われるため、RTXシリーズのGPUやウェブカム以外に特別な機器は必要としない。

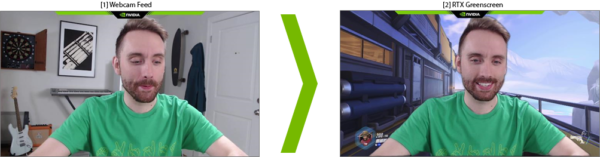

グリーンバック不要のリアルタイムクロマキー合成は、2018年にGoogleがスマートフォン向けに発表したことも記憶に新しい。GeForce RTXユーザーであればRTX Broadcast Engineで同等の機能が利用できる。

このRTX Greenscreenは、主要なライブストリーミングアプリケーションの1つであるOBS(Open Broadcaster Software)とも統合されることを発表。今後数ヶ月で利用できるようになるという。

RTX ARは標準的なウェブカムでフェイストラッキングだけでなく、フェイスランドマークトラッキングも可能となっている。目鼻口などの位置をトラッキングできるため、利用者は自分の顔で3Dモデルを動かすこともできる。

すこしめずらしいのがRTX Style Filtersだ。一部の画像編集ソフトでは以前から利用できる機能だが、リアルタイムの動画で手軽に利用できる例はあまりないのではないだろうか。

動画ではゴッホの絵のスタイルに基づき、ストリーマーの顔や部屋をリアルタイムで描き換えている。モノクロやキュビズム風のフィルターなど、スタイルトランスファーと呼ばれる技術を利用した多様なフィルターをユーザーが用意できる。

RTX Broadcast Engineに必要なのは、GeForce RTX 2060かQuadro RTX 3000以上のGPU、Windows 10 64bit、グラフィックスドライババージョン410.48以上となっている。

RTX Broadcast Engineは現在一部のパートナーにのみ早期アクセス権が与えられているが、まもなくほかの開発者にも公開される。早く早期アクセスに参加したい方は、公式サイトのメーリングリストに登録してほしい。

ライター/古嶋誉幸